📝 ملخص كورس علم البيانات - 8

هذا الملخص عن طريقة تطبيق Gradient Descent في الشبكات العصبية وطريقة تدريبها وتجنب فرط التخصيص.

الفصل الثاني - التعلم العميق Deep Learning

الدرس الثاني - Implementing Gradient Descent

فكرة Gradient Descent هي طريقة تحسين النتائج في كل خطوة والتكرار حتى تصل لنقطة تكون فيها النتائج مرضية. 1

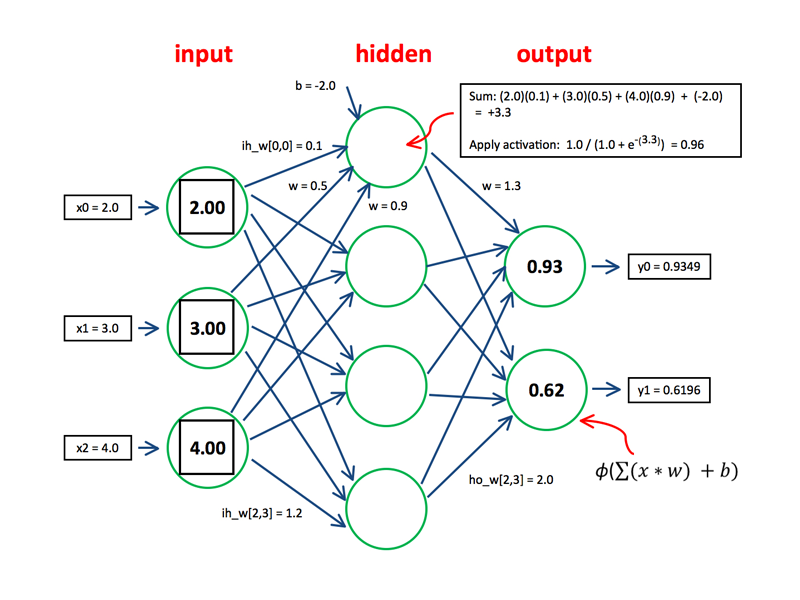

Multilayer Perceptrons

كيفية عملية الحساب داخل الخلية العصبية كالتالي: 2

مثال عملي: الجزء الأول، الجزء الثاني

Backpropagation

طريقة أخرى لتعليم الخلية العصبية، مثال عملي مع شرح بأكواد بايثون هنا

الفصل الثاني - التعلم العميق Deep Learning

الدرس الثالث - Training Neural Networks

طرق لتجنب فرط التخصيص Overfitting

متغيرات

العودة إلى ملخص كورس علم البيانات - 7 - الإنتقال إلى ملخص كورس علم البيانات - 9

كُتب في 29/03/2019